你开着 VPN,打开了 Cursor 或 GitHub Copilot,结果代码建议要等两三秒才出现,或者时不时完全没反应。比完全连不上更烦:工具"能用",但用起来让人抓狂。

这种卡顿通常有两个根源:代理配置问题 和 网络延迟问题。两者的修复方法完全不同——本文带你从最简单的设置排查开始,一路查到网络层的根本原因。

第一步:先排查 Cursor / Copilot 的代理设置

在换 VPN 节点之前,先确认工具本身的代理设置是否正确。这一步很多人跳过了,但它能解决相当一部分"翻墙后还是慢"的问题。

Cursor:检查 HTTP 兼容模式

Cursor 默认使用 HTTP/2 协议。在某些 VPN 环境或公司内网下,HTTP/2 会被拦截,导致连接失败或响应极慢。

修复步骤:

- 打开 Cursor → 左下角「设置」→ 搜索

Network - 找到 HTTP Compatibility Mode,将其从默认的

HTTP/2改为HTTP/1.1 - 点击 Run Diagnostic 验证连通性

GitHub Copilot:确认代理流量被捕获

Copilot 有时不走系统代理,需要通过 Proxifier(Windows/macOS)或在 IDE 内手动指定代理地址,强制让 Copilot 的流量走 VPN 通道。

如果以上设置都没问题,但卡顿依然存在,那你遇到的是更底层的网络问题——这才是本文的核心。

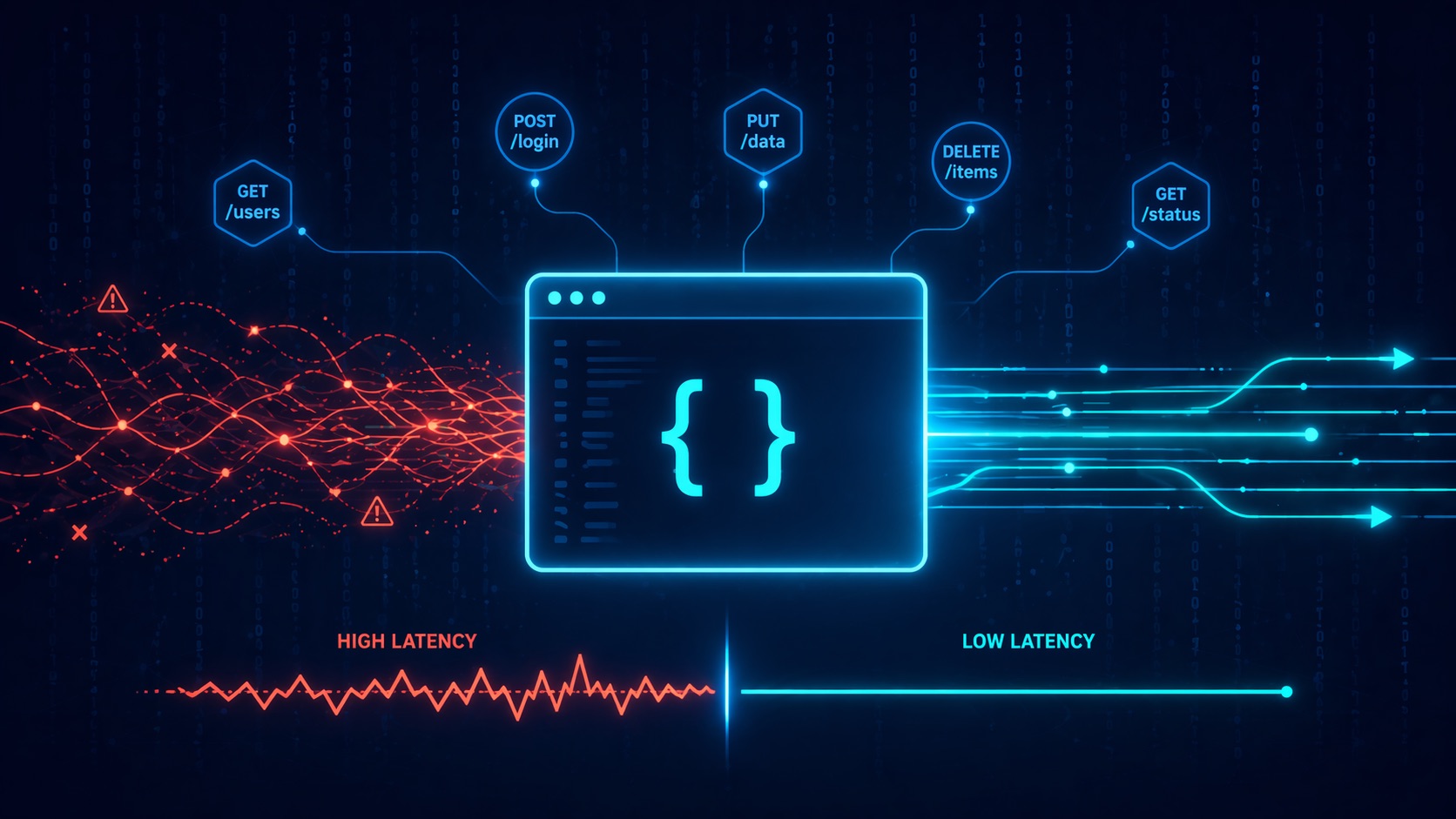

为什么 AI 编程对延迟极度敏感?

要理解根源,需要先搞清楚一个关键区别:带宽(Bandwidth) 和 延迟(Latency)。

一个直觉比喻:

- 带宽:水管的粗细,决定单位时间内能传多少数据

- 延迟:拧开水龙头到水真正流出来的等待时间

这两个指标对不同场景的重要性截然不同:

| 场景 | 对带宽的要求 | 对延迟的要求 | 能否缓冲 |

|---|---|---|---|

| YouTube 4K 视频 | 高 | 低 | ✅ 可以预加载缓冲 |

| 视频会议 (Zoom) | 中 | 高 | ❌ 必须实时 |

| AI 编程助手 | 低 | 极高 | ❌ 每次击键都要即时响应 |

| 在线游戏 | 低 | 极高 | ❌ 必须实时 |

AI 编程助手的每一次交互(你输入代码 → 请求发出 → 模型推理 → 返回补全)是一个完整的往返过程。整个链路需要在 200ms 以内完成,你才能感觉"流畅"。超过 300ms,你就会感知到明显的"反应慢了半拍";超过 500ms,心流完全被打断。

普通机场的延迟瓶颈

即使是质量不错的商业机场,其网络路径通常是:

你的电脑 → 本地 ISP → 公共互联网(多跳路由)→ 机场服务器 → 目标服务

这条路径存在三个结构性问题:

1. 路由不稳定,动态绕路

公共互联网的数据包经过多个运营商节点"接力转发",路径随拥堵情况动态变化,经常出现绕道现象。一个到日本理论上只需 50ms 的路径,实际可能走了 180ms。

2. 抖动(Jitter)致命

"抖动"是延迟的波动性。机场节点的延迟可能:第一个请求 60ms,第二个 200ms,第三个 80ms。对 AI 编程这种需要持续、稳定响应的场景,剧烈抖动比单纯的"慢"更糟糕——你根本不知道下一次建议什么时候会来。

3. 晚高峰拥堵

大部分机场共享服务器带宽,在晚间 8-11 点高峰期,延迟可能比平时高出 2-3 倍。

普通机场 vs IEPL 专线:延迟实测数据

**IEPL(国际以太网专线)**在物理层面绕开了公共互联网,是运营商级别的点对点光纤连接:

你的电脑 → 本地 ISP → IEPL 入口 → 私有光纤 → IEPL 出口 → 目标服务

以下是典型场景下的延迟对比(以中国大陆用户访问美国 AI 服务为例):

| 指标 | 普通机场节点 | IEPL 专线节点 |

|---|---|---|

| 平均延迟(到日本/香港落地) | 80–200ms | 30–60ms |

| 延迟抖动(Jitter) | 高(±50–100ms) | 极低(±5–15ms) |

| 晚高峰延迟变化 | 明显上升(+100–200ms) | 基本不变 |

| Cursor 补全感知体验 | 明显卡顿,时快时慢 | 接近本地响应感 |

| 连接稳定性 | 偶发断线、重连 | 高稳定,适合长时工作 |

对 AI 编程助手来说,最关键的不是"平均延迟多少",而是抖动是否可控。IEPL 专线的低抖动特性,才是它真正的核心优势。

开发者节点选择指南

使用支持 IEPL 专线的服务(如 Jetstream)时,节点选择决定了最终延迟:

| 节点位置 | 适合访问的服务 | 参考延迟(大陆→节点) |

|---|---|---|

| 香港 IEPL | GitHub、Google Cloud、大部分 AI API | 20–40ms |

| 日本 IEPL | OpenAI / Anthropic 美西服务(亚太落地) | 40–70ms |

| 台湾 IEPL | 综合备用,AI 服务稳定性好 | 30–55ms |

| 美西节点 | 直连 OpenAI / Cursor 后端(延迟高但直连) | 150–200ms |

建议:在 Jetstream 客户端中,使用节点测速功能对比各节点的实时延迟,选择当前最低延迟的节点——不同时段最优节点会有变化。

常见问题 FAQ

Q:换了 IEPL 节点后,Cursor 就一定不卡了吗?

不一定。Cursor 的响应时间由两部分组成:你到 Cursor 服务器的网络延迟 + Cursor 后端模型推理时间(这部分你无法控制)。IEPL 能解决前者;高峰期模型服务器本身排队导致的等待,属于后者。实际体验中,IEPL 能将大多数卡顿问题减少 60-80%。

Q:普通机场换成"高速节点"或"游戏加速节点"有用吗?

部分有用,但本质区别在于底层线路。标注"游戏"的节点通常有一定 QoS 优化,可以减少抖动;但如果走的仍然是公共互联网,结构性的路由不稳定问题无法根除。

Q:Copilot 和 Cursor 哪个对延迟更敏感?

Cursor 的内联补全(Tab 自动完成)对延迟要求最高,因为每次击键都触发请求。GitHub Copilot 的补全逻辑类似,延迟敏感度相当。而 Chat 模式(对话式提问)相对不那么敏感,300ms 以内通常感知不明显。

Q:Jetstream 的 IEPL 节点和普通 VPN 价格差多少?

Jetstream 的 IEPL 专线方案针对专业用户定价,具体价格和套餐详情参见官网价格页。对于深度依赖 AI 编程工具的开发者,提升的生产力通常远超额外的网络成本。

总结:分层排查,对症下药

| 症状 | 可能原因 | 解决方案 |

|---|---|---|

| Cursor 提示"Connection failed" | HTTP/2 兼容问题 | 切换 HTTP 兼容模式为 HTTP/1.1 |

| Copilot 完全不走代理 | 代理未捕获该流量 | 使用 Proxifier 强制代理 |

| 补全时快时慢,抖动大 | 机场节点抖动高 | 切换至 IEPL 专线节点 |

| 晚高峰明显变慢 | 共享机场带宽拥堵 | 使用 IEPL 专线(不受公网拥堵影响) |

| 所有时段都慢 | 网络路由绕路 | 切换低延迟 IEPL 节点(港/日/台) |

AI 编程工具已经是开发者工作流的核心基础设施。当你的网络成为瓶颈时,升级到专为低延迟设计的 IEPL 专线——这笔投入的回报,是每天数小时被卡顿蚕食的注意力和专注度。

Telegram

Telegram